Instruções aos autores sobre o uso da IA: o que dizem os editores?

Recentemente a revista BMJ publicou uma análise cientométrica sobre a existência de “Instruções de editores e periódicos aos autores sobre o uso da inteligência artificial generativa na publicação acadêmica e científica”, em inglês Publishers’ and journals’ instructions to authors on use of generative artificial intelligence in academic and scientific publishing: bibliometric analysis [1].

Segundo a Wikipedia, “Inteligência artificial generativa ou IA generativa é um tipo de sistema de IA capaz de gerar texto, imagens ou outras mídias em resposta a solicitações em linguagem comum.” [2]

Apresentamos aqui um resumo do artigo, incluindo os objetivos, metodologia, abrangência e alguns dos resultados obtidos. Esta matéria pode ser útil a editores de revistas científicas e acadêmicas, bem como a autores e bibliotecários interessados em publicações científicas.

Apresentação

Na última década, os avanços na inteligência artificial (IA) estimularam a criação de muitas ferramentas baseadas em IA para utilização em investigação. A IA generativa (GAI) utiliza grandes modelos de linguagem para gerar respostas exclusivas baseadas em texto ou imagem às solicitações do usuário e ganhou popularidade desde o lançamento de transformadores generativos pré-treinados (GPT) – ou seja, ChatGPT lançado pela organização de pesquisa de IA OpenAI em 30 de novembro de 2022. Em dois meses, o ChatGPT atingiu 100 milhões de usuários mensais, tornando-se na época a adoção de tecnologia mais rápida da história. Agora, outros produtos semelhantes estão a ser desenvolvidos por grandes empresas tecnológicas, como a Google com a Bard e a MedPalm e a Microsoft com o Bing Chat.

O advento desta nova tecnologia resultou num grande aumento no interesse por parte do meio académico, acompanhado por uma aceleração pronunciada na utilização potencial.

Até o momento, mais de 650 artigos de pesquisa e editoriais discutiram as aplicações e as armadilhas do GAI, muitos dos quais utilizam o próprio GAI no processo de pesquisa e redação.

No contexto da pesquisa e da redação acadêmica, os estudos mencionam frequentemente a capacidade do GAI de melhorar a gramática e o vocabulário, traduzir textos para vários idiomas, propor novas ideias de pesquisa, sintetizar grandes quantidades de informações, sugerir testes estatísticos, escrever códigos e conteúdo textual novo, agilizar o processo geral de pesquisa. Os autores foram avisados de que o GAI não pode ser responsabilizado pelos seus resultados, que, entre várias armadilhas, incluem o risco de imprecisão, parcialidade e plágio.

Em dezembro de 2022, a Nature publicou o primeiro artigo discutindo preocupações sobre o uso de ChatGPT e GAI na redação científica.

Desde então, periódicos e editores começaram a atualizar suas políticas editoriais e instruções aos autores para fornecer orientações sobre como divulgar o uso do GAI na pesquisa científica.

A Science publicou um artigo em janeiro de 2023 declarando sua decisão de proibir o uso do GAI para gerar texto, figuras, imagens ou gráficos no processo de escrita, e considera a violação da política como constituindo má conduta científica. Outros periódicos permitiram o uso do GAI com restrições e exigência de divulgação completa.

O Comitê de Ética em Publicações (COPE), uma organização composta por editores, editores, universidades e institutos de pesquisa que ajuda a informar a ética de publicação em todas as disciplinas acadêmicas, divulgou uma declaração sobre ferramentas de IA em publicações de pesquisa em fevereiro de 2023, enfatizando que “As ferramentas de IA não podem cumprir os requisitos de autoria, pois não podem assumir a responsabilidade pelo trabalho submetido”, ao mesmo tempo que sugere formas de divulgar o uso da IA e enfatiza que os autores são responsáveis pelo trabalho produzido pelas ferramentas de IA.

Mesmo que a atual declaração do COPE sobre IA seja prontamente endossada por periódicos (por exemplo, Journal of the American Medical Association) e associações editoriais (por exemplo, Associação Mundial de Editores Médicos (WAME)), ela não fornece uma visão abrangente e funcional conjunto de recomendações sobre aspectos chave para orientar o uso responsável da ferramenta GAI na redação científica. Especificamente, a declaração não aborda certas armadilhas potenciais destas ferramentas e não oferece uma declaração de divulgação padrão detalhando elementos específicos a serem incluídos. Esta lacuna na padronização levou a uma variedade de orientações personalizadas formuladas por revistas e editores individuais para lidar com o uso da IA em publicações científicas.

Examinamos a extensão e a natureza das diretrizes para autores referentes ao uso do GAI nas 100 maiores editoras acadêmicas e nas 100 revistas científicas mais bem classificadas. Nosso objetivo foi identificar características compartilhadas, quaisquer detalhes metodológicos sobre como as diretrizes foram desenvolvidas e variações nas diretrizes, com o objetivo de avaliar pontos em comum e divergências nas orientações sobre GAI em publicações acadêmicas.

Objetivo

Determinar a extensão e o conteúdo das orientações de editores acadêmicos e revistas científicas para autores sobre o uso de inteligência artificial generativa (Generative Artificial Intelligence GAI).

Desenho e Configuração do Estudo

Estudo transversal, bibliométrico. Sites de editoras acadêmicas e revistas científicas, exibidos de 19 a 20 de maio de 2023, com busca atualizada de 8 a 9 de outubro de 2023.

Participantes

As 100 maiores editoras acadêmicas e as 100 revistas científicas mais bem classificadas, independentemente do assunto, idioma ou país de origem. Os editores foram identificados pelo número total de periódicos em seu portfólio, e os periódicos foram identificados por meio do ranking de periódicos Scimago usando o índice de Hirsch (índice H) como indicador de produtividade e impacto dos periódicos.

Resultado primário

Conteúdo das diretrizes da GAI listadas nos sites dos 100 principais editores acadêmicos e periódicos científicos, e a consistência das orientações entre os editores e seus periódicos afiliados.

Análise dos Resultados

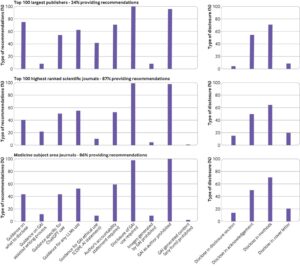

- Entre os 100 maiores editores, 24% forneceram orientação sobre o uso da GAI, dos quais 15 (63%) estavam entre os 25 principais editores.

- Entre os 100 periódicos mais bem avaliados, 87% forneceram orientação sobre GAI.

- Das editoras e periódicos com diretrizes, a inclusão da GAI como autor foi proibida em 96% e 98%, respectivamente.

- Apenas um periódico (1%) proibiu explicitamente o uso da GAI na geração de um manuscrito, e dois (8%) editores e 19 (22%) periódicos indicaram que suas diretrizes se aplicavam exclusivamente ao processo de redação.

- Ao divulgar o uso da GAI, 75% dos editores e 43% dos periódicos incluíram critérios de divulgação específicos. Os locais de divulgação do uso da GAI variaram, inclusive nos métodos ou agradecimentos, na carta de apresentação ou em uma nova seção.

- Também foi encontrada variabilidade na forma de acessar as diretrizes da GAI compartilhadas entre periódicos e editores.

- As diretrizes GAI em 12 periódicos conflitaram diretamente com aquelas desenvolvidas pelos editores. As diretrizes desenvolvidas pelas principais revistas médicas eram amplamente semelhantes às das revistas acadêmicas.

Conclusões

- Faltam diretrizes de alguns dos principais editores e periódicos sobre o uso da GAI pelos autores.

- Entre aqueles que forneceram diretrizes, os usos permitidos do GAI e a forma como ele deveria ser divulgado variaram substancialmente, com essa heterogeneidade persistindo em alguns casos entre editores e periódicos afiliados.

- A falta de padronização representa um fardo para os autores e pode limitar a eficácia dos regulamentos. À medida que a popularidade do GAI continua a crescer, são necessárias diretrizes padronizadas para proteger a integridade da produção científica.

Apesar da heterogeneidade substancial na orientação dos editores, foram identificados dois temas principais. Em primeiro lugar, os editores proibiram consistentemente a GAI de ser autor – nomeadamente porque as ferramentas da GAI não podem assumir responsabilidade pelo conteúdo criado; um princípio padrão de autoria e consistente com a posição do COPE.

Em segundo lugar, os editores incentivaram a divulgação do uso do GAI. A natureza desta divulgação variou substancialmente de acordo com as diretrizes dos editores, como o local apropriado para ser citada no manuscrito.

A maioria dos editores com diretrizes GAI especificou quais detalhes incluir na divulgação, solicitando uma variedade de critérios de relatório, como nome do modelo, versão, fonte, descrição e uso. A Elsevier forneceu um modelo padronizado que incluía o nome da ferramenta ou serviço GAI utilizado e o motivo de seu uso.

Em segundo lugar, os editores incentivaram a divulgação do uso do GAI. A natureza desta divulgação variou substancialmente de acordo com as diretrizes dos editores, como o local apropriado para ser citada no manuscrito.

A maioria dos editores com diretrizes GAI especificou quais detalhes incluir na divulgação, solicitando uma variedade de critérios de relatório, como nome do modelo, versão, fonte, descrição e uso. A Elsevier forneceu um modelo padronizado que incluía o nome da ferramenta ou serviço GAI utilizado e o motivo de seu uso.

Clique na imagem para melhor visualização.

Além disso, os tipos e usos das ferramentas GAI às quais as diretrizes se aplicavam variavam entre os editores.

Por exemplo, embora as orientações de alguns editores se referissem apenas ao “texto gerado por IA”, outras também abrangiam a produção de imagens e análise de dados. Várias das diretrizes forneceram exemplos vagos de uso, como “contribuições acadêmicas”, “criação de conteúdo” e “preparação de um manuscrito”, introduzindo outro elemento de confusão para os autores.

Além disso, os critérios de divulgação ortográficos e gramaticais levantam questões sobre se as ferramentas que integram a tecnologia GAI principalmente para esse fim devem obedecer aos mesmos padrões de divulgação. Esta questão terá de ser respondida, uma vez que programas como o Grammarly e o Microsoft Office estão implementando a GAI nas suas ferramentas ortográficas e gramaticais.

Finalmente, nem todos os editores exigiram explicitamente que os autores assumissem a responsabilidade pelos resultados produzidos pelo GAI. Isto pode causar confusão sobre a responsabilidade e propriedade do conteúdo gerado pelas ferramentas de IA e deve ser responsabilizado pelos editores.

Durante os cinco meses entre as nossas duas pesquisas de diretrizes para editores, o número de editores que relataram diretrizes aumentou 40%, mostrando o interesse contínuo no desenvolvimento de diretrizes. Além disso, as diretrizes mais recentes mostraram uma ênfase maior na geração de imagens e em critérios de divulgação específicos.

Embora a Elsevier tenha atualizado suas diretrizes para incluir uma seção sobre geração de imagens, seus principais periódicos ainda não atualizaram suas diretrizes para incluir essas informações, mesmo fornecendo um link para o editor; mais uma ilustração da necessidade de diretrizes padronizadas para garantir adesão adequada e confusão mínima para os autores.

Identificamos fontes de heterogeneidade nas diretrizes do GAI entre os editores e periódicos, inclusive na divulgação das diretrizes relacionadas ao GAI. Embora alguns periódicos não apenas apresentassem suas próprias diretrizes GAI, mas também fornecessem um link direto para as diretrizes idênticas dos editores, houve casos em que os periódicos emitiram orientações sem fornecer tal link. Por outro lado, alguns periódicos forneceram apenas um link para as diretrizes de seus editores. Esta discrepância resulta na falta de centralização da informação sobre a utilização do GAI.

Consequentemente, cabe aos autores a responsabilidade de buscar e compreender as diretrizes disponíveis. Esta configuração permite potencialmente que os autores utilizem inadvertidamente as ferramentas GAI na redação científica devido a uma compreensão incompleta das regulamentações impostas por periódicos ou editores.

Além de um local não centralizado para informações sobre o uso de GAI, também encontramos vários exemplos de recomendações e orientações concorrentes. Estas inconsistências representam desafios à medida que os autores procuram as diretrizes apropriadas e devem decidir quais padrões seguir.

Também encontramos heterogeneidade nos tipos de palavras utilizadas. As diretrizes frequentemente usavam termos como “divulgar”, “relatar”, “descrever”, “reconhecer” e “documentar” de forma intercambiável ao instruir os autores sobre como apresentar o uso de IA generativa em seus manuscritos. Isto pode levar à confusão, uma vez que estas palavras têm definições distintas – por exemplo, a divulgação de um conflito de interesses não é o mesmo que um reconhecimento de um colaborador no contexto da publicação científica.

Vários periódicos e editores não estipularam que os autores seriam responsáveis pelos resultados do GAI.

Entretanto, a declaração do COPE sobre IA afirma que os autores são “totalmente responsáveis” pelo seu trabalho, incluindo qualquer parte produzida pela IA. Isto é importante porque, como observaram editoras como a Elsevier e a SAGE, o GAI pode produzir resultados imprecisos, tendenciosos ou enganosos. Sabe-se que as ferramentas GAI “alucinam” e fabricam informações infundadas.

== REFERÊNCIAS ==

[1] Ganjavi C, Eppler M B, Pekcan A, Biedermann B, Abreu A, Collins G S et al. Publishers’ and journals’ instructions to authors on use of generative artificial intelligence in academic and scientific publishing: bibliometric analysis BMJ 2024, n. 384, e077192 URL: https://www.bmj.com/content/384/bmj-2023-077192 DOI: https://doi.org/10.1136/bmj-2023-077192 Acesso em: 17 fev. 2024

.[2] WIKIPEDIA. Inteligência artificial generativa. Disponível em: https://pt.wikipedia.org/wiki/Intelig%C3%AAncia_artificial_generativa Acesso em: 17 fev. 2024.